Greitas kontūras

Šis įrašas parodys:

Kaip įdiegti „ReAct“ logiką naudojant „LangChain“ dokumentų saugyklą

- Frameworkų diegimas

- Pateikiamas OpenAI API raktas

- Bibliotekų importavimas

- Naudojant Wikipedia Explorer

- Modelio testavimas

Kaip įdiegti „ReAct“ logiką naudojant „LangChain“ dokumentų saugyklą?

Kalbos modeliai mokomi naudojant didžiulį duomenų, parašytų natūraliomis kalbomis, pavyzdžiui, anglų kalba ir kt., telkinį. Duomenys tvarkomi ir saugomi dokumentų saugyklose, o vartotojas gali tiesiog įkelti duomenis iš parduotuvės ir išmokyti modelį. Modelio mokymas gali trukti daug kartų, nes kiekviena iteracija daro modelį efektyvesnį ir patobulintą.

Norėdami sužinoti, kaip įdiegti „ReAct“ logiką dirbant su „LangChain“ dokumentų saugykla, tiesiog vadovaukitės šiuo paprastu vadovu:

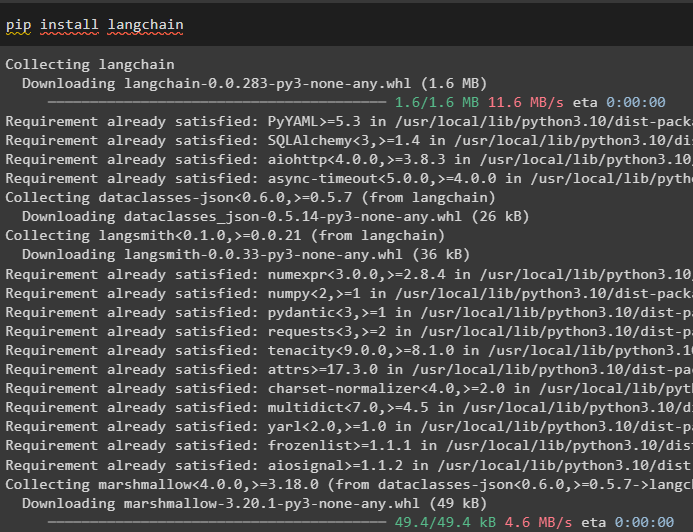

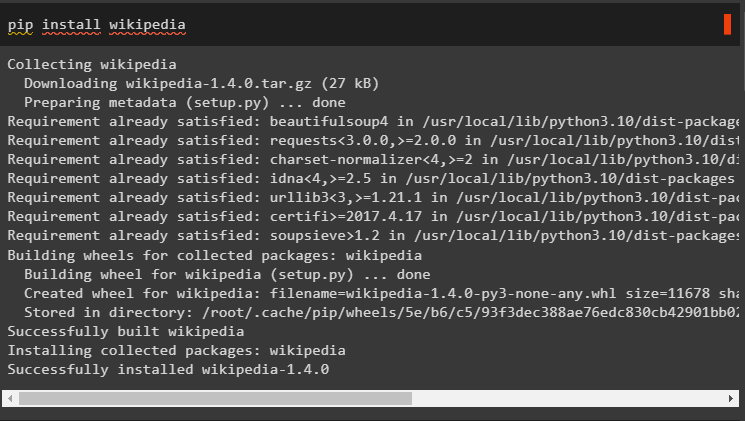

1 veiksmas: „Frameworks“ diegimas

Pirmiausia pradėkite nuo ReAct logikos, skirtos darbui su dokumentų saugykla, diegimo proceso, įdiegdami „LangChain“ sistemą. Įdiegę „LangChain“ sistemą gausite visas reikalingas priklausomybes, kad gautumėte arba importuotumėte bibliotekas procesui užbaigti:

pip įdiegti langchain

Įdiekite šio vadovo Vikipedijos priklausomybes, nes ją galima naudoti norint, kad dokumentų saugyklos veiktų su ReAct logika:

pip įdiegti wikipedia

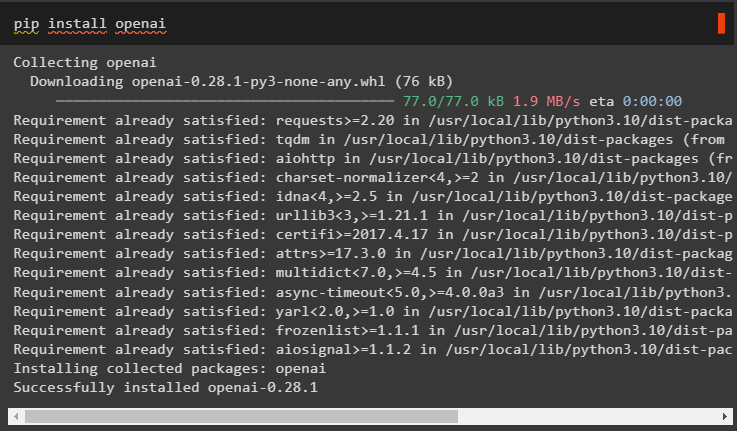

Įdiekite OpenAI modulius naudodami pip komandą, kad gautumėte jos bibliotekas ir sukurtumėte didelių kalbų modelius arba LLM:

pip install openai

2 veiksmas: Pateikite OpenAI API raktą

Įdiegę visus reikiamus modulius, tiesiog sutvarkyti aplinką naudojant API raktą iš OpenAI paskyros, naudojant šį kodą:

importuoti tuimportuoti gauti pasą

tu . maždaug [ „OPENAI_API_KEY“ ] = gauti pasą . gauti pasą ( 'OpenAI API raktas:' )

3 veiksmas: bibliotekų importavimas

Kai aplinka bus nustatyta, importuokite bibliotekas iš LangChain, kurios reikalingos norint sukonfigūruoti ReAct logiką darbui su dokumentų saugyklomis. LangChain agentų naudojimas norint gauti DocstoreExplaorer ir agentus su jo tipais kalbos modeliui sukonfigūruoti:

iš langchain. llms importuoti OpenAIiš langchain. daktaras importuoti Vikipedija

iš langchain. agentai importuoti inicijuoti_agentą , Įrankis

iš langchain. agentai importuoti Agento tipas

iš langchain. agentai . reaguoti . bazė importuoti DoctoreExplorer

4 veiksmas: naudokite „Wikipedia Explorer“.

Konfigūruoti ' daktaras ” kintamąjį su DocstoreExplorer() metodu ir iškvieskite Wikipedia() metodą savo argumente. Sukurkite didelės kalbos modelį naudodami OpenAI metodą su „ text-davinci-002 “ modelis nustačius agento įrankius:

daktaras = DoctoreExplorer ( Vikipedija ( ) )įrankiai = [

Įrankis (

vardas = 'Paieška' ,

func = daktaras. Paieška ,

apibūdinimas = 'Jis naudojamas užklausoms / raginimams su paieška pateikti' ,

) ,

Įrankis (

vardas = 'Žiūrėti' ,

func = daktaras. paieška ,

apibūdinimas = 'Jis naudojamas užklausoms / raginimams pateikti su peržvalga' ,

) ,

]

llm = OpenAI ( temperatūros = 0 , Modelio vardas = 'text-davinci-002' )

#apibrėžiant kintamąjį konfigūruojant modelį su agentu

reaguoti = inicijuoti_agentą ( įrankiai , llm , agentas = Agento tipas. REACT_DOCSTORE , žodinis = Tiesa )

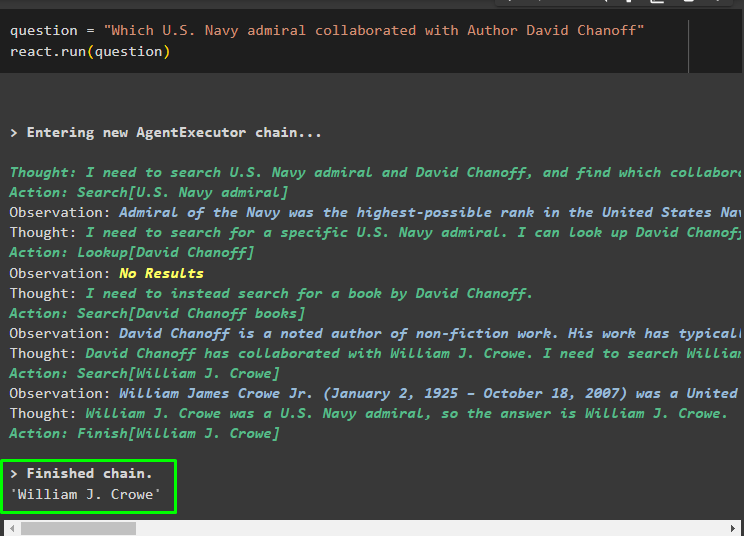

5 veiksmas: modelio testavimas

Kai modelis bus sukurtas ir sukonfigūruotas, nustatykite klausimo eilutę ir paleiskite metodą su klausimo kintamuoju argumente:

klausimas = „Kuris JAV karinio jūrų laivyno admirolas bendradarbiavo su autoriumi Davidu Chanoffu“reaguoti. paleisti ( klausimas )

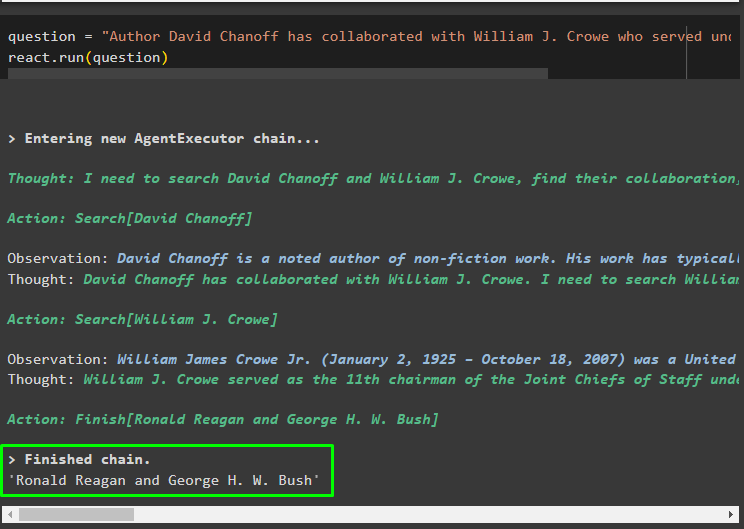

Įvykdžius klausimo kintamąjį, modelis suprato klausimą be jokio išorinio raginimo šablono ar mokymo. Modelis apmokomas automatiškai, naudojant ankstesniame žingsnyje įkeltą modelį ir atitinkamai generuojant tekstą. „ReAct“ logika dirba su dokumentų saugyklomis, kad gautų informaciją pagal klausimą:

Užduokite dar vieną klausimą iš dokumentų saugyklų modeliui pateiktų duomenų ir modelis išskirs atsakymą iš parduotuvės:

klausimas = „Autorius Davidas Chanoffas bendradarbiavo su Williamu J Crowe, kuris tarnavo kuriam prezidentui?reaguoti. paleisti ( klausimas )

Tai viskas apie ReAct logikos įgyvendinimą dirbant su dokumentų saugykla LangChain.

Išvada

Norėdami įdiegti „ReAct“ logiką darbui su „LangChain“ dokumentų saugykla, įdiekite kalbos modelio kūrimo modulius arba sistemas. Po to nustatykite OpenAI aplinką, kad sukonfigūruotumėte LLM, ir įkelkite modelį iš dokumentų saugyklos, kad įgyvendintumėte ReAct logiką. Šiame vadove išsamiai aprašyta, kaip įdiegti „ReAct“ logiką dirbant su dokumentų saugykla.