Šiame straipsnyje pateikiamas nuoseklus vadovas apie žetonų naudojimą Hugging Face Transformers.

Kas yra Tokenizatorius?

Žetonizatorius yra svarbi NLP sąvoka, o pagrindinis jos tikslas – neapdorotą tekstą paversti skaičiais. Šiuo tikslu yra įvairių technikų ir metodų. Tačiau verta paminėti, kad kiekviena technika tarnauja tam tikram tikslui.

Kaip naudoti žetonus apkabinamuose veido transformatoriuose?

Kaip naudoti žetonus apkabinamuose veido transformatoriuose?

Žetonizatorių biblioteka turi būti įdiegta prieš naudojant ją ir iš jos importuojant funkcijas. Po to apmokykite modelį naudodami „AutoTokenenizer“, tada pateikite įvestį, kad galėtumėte atlikti prieigos raktą.

Hugging Face pristato tris pagrindines tokenizacijos kategorijas, kurios pateikiamos žemiau:

- Žodžiu pagrįstas Tokenizer

- Simbolių pagrindu sukurtas Tokenizeris

- Pokalbių pagrindu sukurtas Tokenizeris

Štai žingsnis po žingsnio vadovas, kaip naudoti žetonus transformatoriuose:

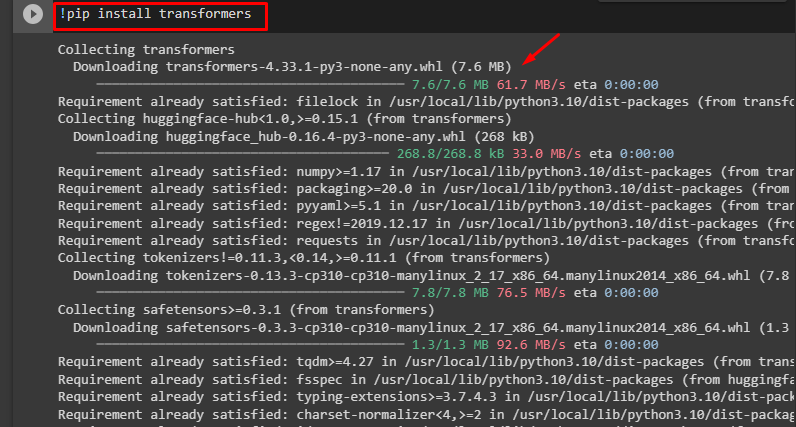

1 veiksmas: įdiekite transformatorius

Norėdami įdiegti transformatorius, naudokite komandą pip šioje komandoje:

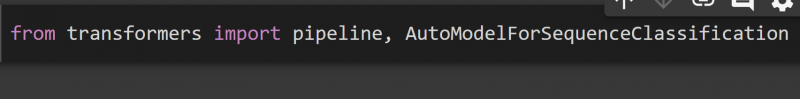

2 veiksmas: importuokite klases

Iš transformatorių, importas dujotiekis , ir „AutoModelForSequenceClassification“. biblioteka klasifikacijai atlikti:

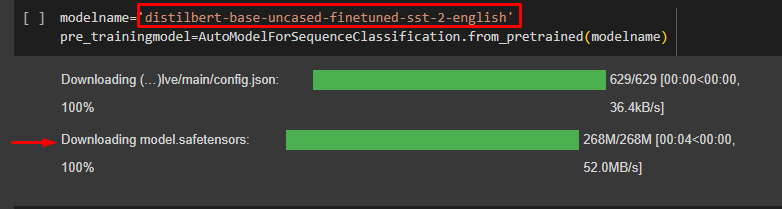

3 veiksmas: importuokite modelį

„ „AutoModelForSequenceClassification“. “ yra metodas, priklausantis automatinei žetonų klasei. The from_pretrained() metodas naudojamas norint grąžinti teisingą modelio klasę pagal modelio tipą.

Čia mes pateikėme modelio pavadinimą „ Modelio vardas “ kintamasis:

Modelio vardas = „distilbert-base-uncased-finetuned-sst-2-english“išankstinio mokymo modelis =AutoModelForSequenceClassification.from_pretrained ( Modelio vardas )

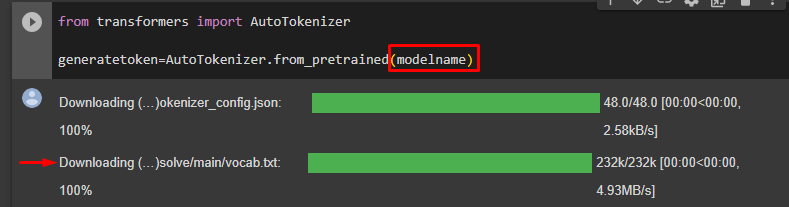

4 veiksmas: importuokite „AutoTokenenizer“.

Pateikite šią komandą, kad sugeneruotumėte žetonus, perduodami „ Modelio vardas “ kaip argumentas:

sugeneruotą žetoną =AutoTokenenizer.from_pretrained ( Modelio vardas )

5 veiksmas: generuokite prieigos raktą

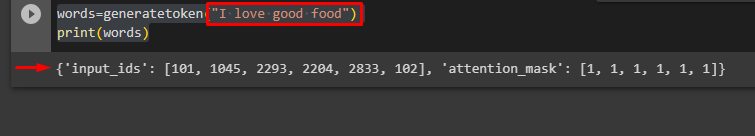

Dabar sakinyje generuosime žetonus „Mėgstu gerą maistą“ naudojant ' sugeneruotą žetoną “ kintamasis:

spausdinti ( žodžius )

Išvestis pateikiama taip:

Kodas aukščiau Google Co pateikiama čia.

Išvada

Norėdami naudoti Tokenizers programoje Hugging Face, įdiekite biblioteką naudodami pip komandą, apmokykite modelį naudodami AutoTokenizer, tada pateikite įvestį, kad būtų atliktas prieigos raktas. Naudodami tokenizaciją, priskirkite žodžiams svorį, pagal kurį jie suskirstyti, kad išlaikytų sakinio prasmę. Šis balas taip pat lemia jų vertę analizei. Šis straipsnis yra išsamus vadovas, kaip naudoti žetonus Hugging Face Transformers.