„LangChain“ yra sistema, kurią galima naudoti importuojant bibliotekas ir priklausomybes kuriant didelių kalbų modelius arba LLM. Kalbos modeliai naudoja atmintį, kad saugotų duomenis arba istoriją duomenų bazėje kaip stebėjimą, kad gautų pokalbio kontekstą. Atmintis sukonfigūruota saugoti naujausius pranešimus, kad modelis galėtų suprasti dviprasmiškus vartotojo pateiktus raginimus.

Šiame tinklaraštyje paaiškinamas atminties naudojimo LLMChain per LangChain procesas.

Kaip naudoti atmintį „LLMChain“ per „LangChain“?

Norėdami pridėti atminties ir naudoti ją LLMChain per LangChain, ConversationBufferMemory biblioteką galima naudoti importuojant ją iš LangChain.

Norėdami sužinoti, kaip naudoti LLMChain atmintį per LangChain, peržiūrėkite šį vadovą:

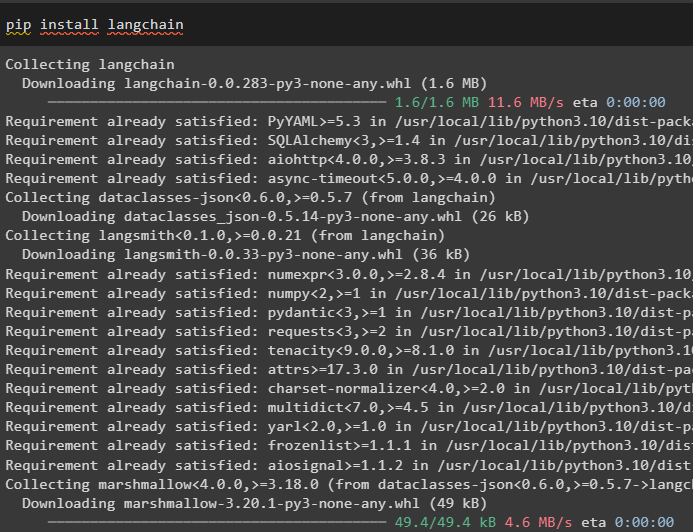

1 veiksmas: įdiekite modulius

Pirmiausia pradėkite atminties naudojimo procesą įdiegdami LangChain naudodami pip komandą:

pip įdiegti langchain

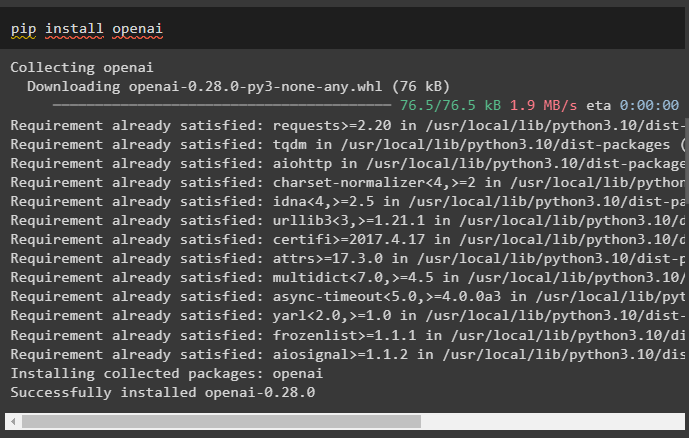

Įdiekite OpenAI modulius, kad gautumėte jo priklausomybes arba bibliotekas, kad sukurtumėte LLM arba pokalbių modelius:

pip install openai

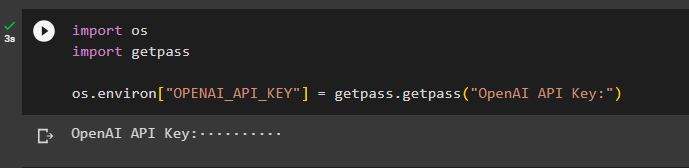

Nustatykite aplinką OpenAI naudojant API raktą, importuojant OS ir getpass bibliotekas:

importuoti musimportuoti getpass

os.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API raktas:')

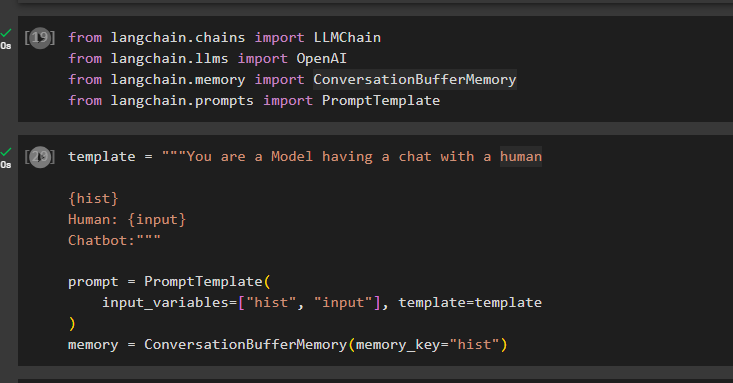

2 veiksmas: bibliotekų importavimas

Nustatę aplinką, tiesiog importuokite bibliotekas, pvz., ConversationBufferMemory, iš LangChain:

iš langchain.chains importuoti LLMChainiš langchain.llms importuoti OpenAI

iš langchain.memory importuoti ConversationBufferMemory

iš langchain.prompts importuoti PromptTemplate

Sukonfigūruokite raginimo šabloną naudodami kintamuosius, pvz., „input“, kad gautumėte užklausą iš vartotojo, ir „hist“, kad duomenys būtų saugomi buferinėje atmintyje:

template = '''Esate modelis, bendraujantis su žmogumi{hist}

Žmogus: {input}

Pokalbių robotas:'''

prompt = PromptTemplate(

input_variables=['hist', 'input'], template=template

)

atmintis = ConversationBufferMemory(memory_key='hist')

3 veiksmas: LLM konfigūravimas

Sukūrę užklausos šabloną, sukonfigūruokite LLMChain() metodą naudodami kelis parametrus:

llm = OpenAI()llm_chain = LLMchain(

llm = llm,

prompt=prompt,

verbose=Tiesa,

atmintis = atmintis,

)

4 veiksmas: LLMChain testavimas

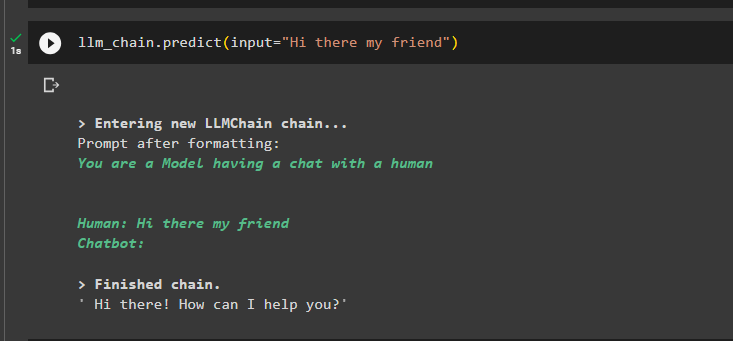

Po to išbandykite LLMChain naudodami įvesties kintamąjį, kad gautumėte vartotojo raginimą tekstine forma:

llm_chain.predict(input='Sveikas, mano drauge')

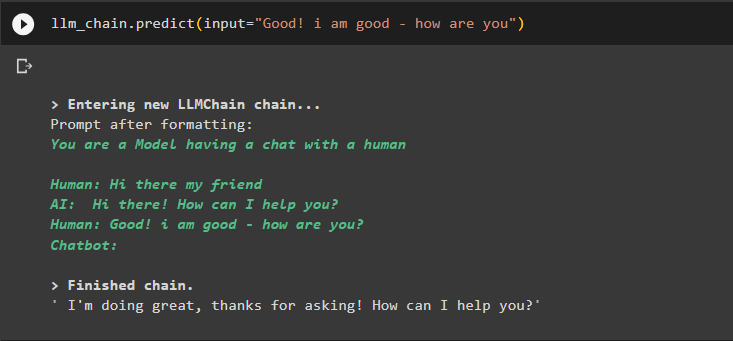

Naudokite kitą įvestį, kad gautumėte duomenis, saugomus atmintyje, kad ištrauktumėte išvestį naudojant kontekstą:

llm_chain.predict(input='Gerai! Man gerai – kaip sekasi')

5 veiksmas: atminties pridėjimas prie pokalbių modelio

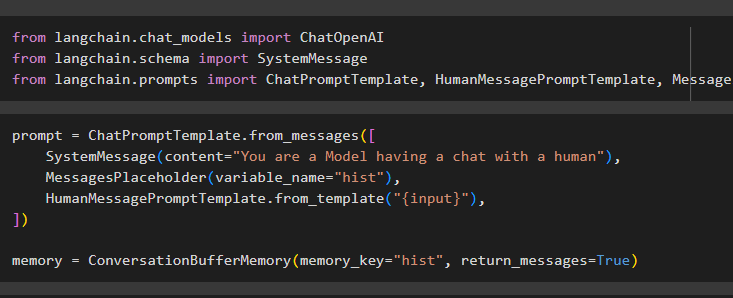

Atmintį galima pridėti prie pokalbių modeliu pagrįstos LLMChain importuojant bibliotekas:

iš langchain.chat_models importuoti ChatOpenAIiš langchain.schema importuoti SystemMessage

iš langchain.prompts importuoti ChatPromptTemplate, HumanMessagePromptTemplate, MessagesPlaceholder

Konfigūruokite raginimo šabloną naudodami ConversationBufferMemory() naudodami skirtingus kintamuosius, kad nustatytumėte vartotojo įvestį:

prompt = ChatPromptTemplate.from_messages([SystemMessage(content='Jūs esate modelis, kuris kalbasi su žmogumi'),

MessagesPlaceholder(variable_),

HumanMessagePromptTemplate.from_template('{input}'),

])

atmintis = ConversationBufferMemory(memory_key='hist', return_messages=True)

6 veiksmas: LLMChain konfigūravimas

Nustatykite LLMChain() metodą, kad sukonfigūruotumėte modelį naudodami skirtingus argumentus ir parametrus:

llm = ChatOpenAI()chat_llm_chain = LLMchain(

llm = llm,

prompt=prompt,

verbose=Tiesa,

atmintis = atmintis,

)

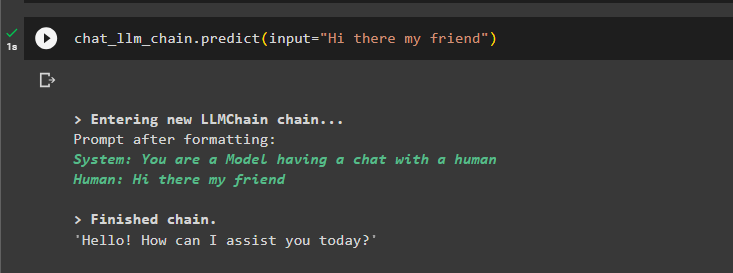

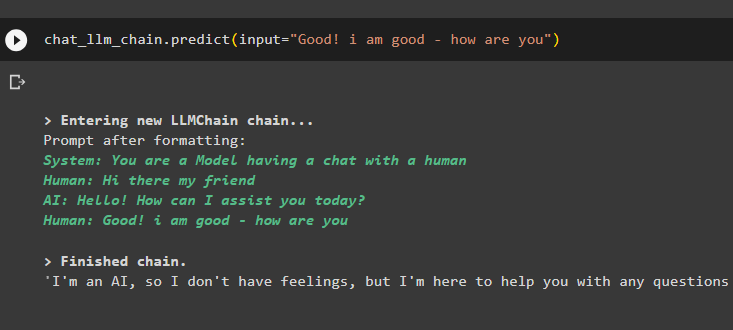

7 veiksmas: LLMChain testavimas

Pabaigoje tiesiog išbandykite LLMChain naudodami įvestį, kad modelis galėtų sugeneruoti tekstą pagal raginimą:

chat_llm_chain.predict(input='Sveikas, mano draugas')

Modelis išsaugojo ankstesnį pokalbį atmintyje ir rodo jį prieš faktinį užklausos išvestį:

llm_chain.predict(input='Gerai! Man gerai – kaip sekasi')

Tai viskas apie atminties naudojimą LLMChain naudojant LangChain.

Išvada

Norėdami naudoti LLMChain atmintį per LangChain sistemą, tiesiog įdiekite modulius, kad nustatytumėte aplinką, kad gautumėte priklausomybes iš modulių. Po to tiesiog importuokite bibliotekas iš „LangChain“, kad naudotumėte buferinę atmintį ankstesniam pokalbiui saugoti. Vartotojas taip pat gali pridėti atminties prie pokalbių modelio, sukurdamas LLMCchain ir tada išbandydamas grandinę pateikdamas įvestį. Šiame vadove išsamiai aprašomas atminties naudojimo LLMChain per LangChain procesas.